في مقاله على موقع E-International Relations، يناقش إيلان مانور كيف يؤدي التهويل المرتبط بالتكنولوجيا—وخاصة الذكاء الاصطناعي—إلى تشكيل السياسات العامة والتصورات المجتمعية حول المستقبل. ويُصنّف الكاتب هذا التهويل في أربع فئات: "التفتح" (Bloom) التي ترى الذكاء الاصطناعي كوسيلة لتحسين جودة الحياة، و"الازدهار" (Boom) التي تعتبره محركًا للنمو الاقتصادي، و"الكآبة" (Gloom) التي تركز على مخاطره المجتمعية كالمعلومات المضللة، و"الهلاك" (Doom) التي تُحذّر من احتمال فناء البشرية. يؤكد مانور أن هذه التصورات، رغم تنوعها، قد تعيق الابتكار وتفرض رؤى مستقبلية ضيقة على صناع القرار. ويقترح في الختام ضرورة تجاوز "فخ التهويل" من خلال تعزيز مشاركة الأطراف المتنوعة وتوسيع نطاق الحوار حول مستقبل الذكاء الاصطناعي، لا سيما عبر منصات مثل "سفارات التكنولوجيا" التي تربط الحكومات بالشركات والمطورين والناشطين.

The Dangers of AI Hype

وفقًا لما ذكره دان كوتليار، فإن التقدّم التكنولوجي يصاحبه قدر من التهويل، أو الخطاب المبالغ فيه. فعلى سبيل المثال، رافق ظهور الإنترنت نوع من التهويل حول الديمقراطية، حيث رأى الباحثون والمحللون أن الإنترنت سيُتيح أشكالًا جديدة من المشاركة الديمقراطية. أما وسائل التواصل الاجتماعي، فقد ارتبطت بتهويل ثوري يوحي بأنها ستساعد في الإطاحة بالطغاة والمستبدين والدكتاتوريين الذين لم يعد بإمكانهم فرض سيطرة تامة على الرأي العام، وقد أسهمت احتجاجات الربيع العربي في تعزيز هذا التصور. وعلى مدى العامين الماضيين، يعيش العالم حالة من "التهويل بالذكاء الاصطناعي". فقد أعلن صحفيون وكبار رجال التكنولوجيا وأكاديميون أن الذكاء الاصطناعي سيغيّر الحياة اليومية بشكل جذري، وسيؤثر على عدد لا يُحصى من المهن، وسيبدّل طريقة إنتاج المعرفة، وإبداع الفن، ومراقبة المواطنين، وصياغة السياسات، وبناء العلاقات الإنسانية. فالأطباء من البشر سيتم استبدالهم بأطباء ذكاء اصطناعي، والروبوتات ستقصي علماء النفس، ومطورو البرمجيات من البشر سيتم استبدالهم بمبرمجي ذكاء اصطناعي، كما سيحل وكلاء الذكاء الاصطناعي محل المحامين والمشرّعين. كل هذه التنبؤات توحي بأن الذكاء الاصطناعي مختلف جوهريًا عن التطورات التكنولوجية السابقة. فـ"لحظة الذكاء الاصطناعي" تُعد تطورًا فيزيائيًا في مسيرة البشرية نحو حالة جديدة من الوجود المُعزّز بالذكاء الاصطناعي.

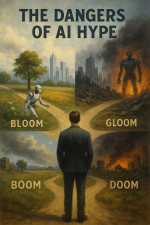

يمكن أن تكون حالات التهويل إيجابية أو سلبية. فظهور الإنترنت أيضًا ترافق مع مخاوف من التفاوت بين الأغنياء والفقراء، أو بين من يستطيع تحمل كلفة الاتصال بالإنترنت ومن سيُستبعد من الساحة الرقمية الجديدة. وهذا ينطبق أيضًا على الذكاء الاصطناعي، إذ يحذّر البعض من أن تطوره قد يبلغ حدًا يجعله يخرج عن السيطرة، ويتجاهل برمجته، ويطلق كوارث غير مسبوقة كالحروب النووية. ما يثير الانتباه في حالات التهويل التكنولوجية هو أنها تشكّل السياسات الحكومية. فحالات التهويل تمثل رؤى مستقبلية، وهي خرائط ذهنية تحدد مجموعة من السيناريوهات الممكنة. ومع ذلك، فإن هذه الرؤى المستقبلية تضع قيودًا على صانعي السياسات، إذ تعيق خيالهم وتمنعهم من توظيف التقنيات الجديدة بطرق مبتكرة وأصيلة. وبدلًا من ذلك، يبدأ صانعو السياسات في رؤية التكنولوجيا من خلال عدسة ضيقة تتشكّل بفعل بعض التصورات السائدة. حاليًا، يبدو أن الدول وصناع السياسات ينظرون إلى الذكاء الاصطناعي من خلال أربع حالات تهويل رئيسية: التفتح (Bloom)، الازدهار المفاجئ (Boom)، الكآبة (Gloom)، والهلاك (Doom).

حالة التهويل "التفتح" ذات طابع إيجابي بطبيعتها، إذ تشير إلى أن الذكاء الاصطناعي سيرفع جودة حياتنا. ستُسهّل تقنيات الذكاء الاصطناعي الطب المُخصص، والرعاية عن بُعد، والطب عن طريق الاتصال، مما يتيح للدول تقديم أفضل رعاية ممكنة للمواطنين. كما سيُنتج المعلمون الآليون مناهج تعليمية مخصصة لكل طالب، مما يساعدهم على تحقيق كامل إمكاناتهم. وستُسهم تقنيات الذكاء الاصطناعي في التنبؤ بالأزمات وحالات الطوارئ والاستجابة لها بسرعة، مع خفض كلفة الخدمات، مثل خفض فواتير الكهرباء بفضل المنازل الذكية. ستصبح الدولة القائمة على الذكاء الاصطناعي أكثر ذكاءً ونظافة وكفاءة. وهذه الرؤية هي ما يؤثر على قرارات صناع السياسات بدمج الذكاء الاصطناعي في مختلف أنظمة الدولة، كالرعاية الصحية والتعليم وحتى الدبلوماسية.

أحد الأمثلة على ذلك هو الاقتراح بإدماج الذكاء الاصطناعي في وزارات الخارجية. ففي يونيو 2023، نشرت اللجنة الاستشارية الأمريكية للدبلوماسية العامة تقريرًا يوضح كيف يمكن للذكاء الاصطناعي أن يتولى وظائف دبلوماسية روتينية، كصياغة بيانات صحفية، وإعداد تقارير، وكتابة محتوى موجه لجماهير مختلفة، واستخدام روبوتات للرد على الطلبات القنصلية. في جميع هذه الحالات، يتمثل الفائدة الأساسية في تقليل عبء العمل على الدبلوماسيين وتمكينهم من العمل بكفاءة وسرعة أكبر. وبالمثل، في مايو 2024، كشفت وزارة الخارجية الأوكرانية عن ناطق رسمي بالذكاء الاصطناعي بهدف صريح يتمثل في "توفير الوقت والموارد"، حيث يتمكن هذا الناطق من الرد على الأحداث أو إعلان التغيرات السياسية بسرعة تفوق أي ناطق بشري. ووفقًا لتقارير المنتدى الاقتصادي العالمي، يجري بالفعل اختبار تقنيات الذكاء الاصطناعي ونشرها في مجالات أخرى، كأنظمة الرعاية الصحية. وتشير التقارير إلى أن الذكاء الاصطناعي يُستخدم لتحسين التشخيصات، وتقصير وقت استجابة سيارات الإسعاف، وتقليل التكاليف الإدارية، والتنبؤ بالمضاعفات الصحية. وهنا أيضًا، تُوظف تقنيات الذكاء الاصطناعي بهدف تحسين الخدمات الحكومية مع خفض التكاليف وزيادة الكفاءة. وهذا هو جوهر حالة التهويل "التفتح".

حالة التهويل "الازدهار" (Boom) هي أيضًا ذات طابع إيجابي بطبيعتها، إذ تشير إلى أن الذكاء الاصطناعي سيقود إلى طفرة مالية تُنتج مصادر جديدة للإيرادات، ووظائف جديدة، وصناعات جديدة، وأيدٍ عاملة ماهرة من نوع مختلف. وتشبه هذه الحالة من التهويل ثورة الذكاء الاصطناعي بالثورات الزراعية أو الصناعية التي غيّرت الاقتصاد العالمي إلى الأبد، فبينما دمّرت بعض أشكال العمل، خلقت العديد من الوظائف الأخرى. وهذه الرؤية هي التي تدفع صانعي السياسات والدول إلى الاستثمار في الصناعات المحلية المعتمدة على الذكاء الاصطناعي، وتشجيع رجال الأعمال المحليين للدخول إلى سوق الذكاء الاصطناعي، وتقديم الحوافز والدعم المالي للأبحاث والتطوير القائمة على الذكاء الاصطناعي، مع اعتبار هذه الصناعات أولوية اقتصادية.

وقد خلصت دراسة نُشرت عام 2024 في مجلة "هارفارد بزنس ريفيو" إلى أن تأثير الذكاء الاصطناعي التوليدي على أسواق العمل بات ملموسًا، مشيرة إلى "تحولات محتملة في ديناميكيات سوق العمل على المدى الطويل، قد تجلب معها تحديات وفرصًا على حد سواء". وتوقّع تقرير آخر صادر عن منظمة العمل الدولية أن الذكاء الاصطناعي سيحل محل 10٪ من القوى العاملة على مستوى العالم. ووفقًا لتقرير "مؤشر الذكاء الاصطناعي لعام 2025" الصادر عن جامعة ستانفورد، شهد العام السابق ارتفاعًا حادًا في الاستثمارات العامة والخاصة في تقنيات الذكاء الاصطناعي. فقد بدأت حكومات عديدة بتخصيص موارد كبيرة لتطوير صناعات الذكاء الاصطناعي المحلية، بما في ذلك كندا (2.4 مليار دولار)، الصين (47.5 مليار دولار لصندوق وطني لأشباه الموصلات)، فرنسا (109 مليار يورو)، الهند (1.25 مليار دولار)، والسعودية (100 مليار دولار). وأشارت منظمة الأمم المتحدة للتنمية الصناعية (اليونيدو) في تقرير لها إلى أن الدول النامية "يجب أن تعطي الأولوية وتسعى لتأسيس منظومات قوية للذكاء الاصطناعي" لتقليص الفجوة بينها وبين الدول الأكثر تطورًا. كل هذه الأمثلة تشير إلى أن صانعي السياسات عالميًا، من منظمات دولية كمنظمة العمل الدولية واليونيدو، إلى صانعي السياسات الوطنيين، ينظرون إلى الذكاء الاصطناعي على أنه أداة ستُغيّر الاقتصادات الوطنية وتحقق نموًا كبيرًا، ما يُجسّد جوهر تهويل "الازدهار".

أما حالة التهويل "الكآبة" (Gloom) فهي سلبية بطبيعتها، وترى الذكاء الاصطناعي من خلال عدسة التحديات الراهنة. فالدول وصناع السياسات يشعرون بالقلق من إمكانية استخدام الذكاء الاصطناعي لنشر المعلومات المضللة ونظريات المؤامرة، وتعزيز الاستقطاب السياسي، وتقويض مرونة المجتمعات، وفي النهاية، تدمير الديمقراطيات. وتفترض هذه الحالة أن المستقبل لن يكون إلا نسخة أكثر تشاؤمًا من الحاضر، حيث تولد الروبوتات كميات غير محدودة من المعلومات المزيفة والمقنعة، مما يضعف قدرة الأفراد على فهم الواقع، ويقود إلى أزمات سياسية واسعة النطاق. وتدفع هذه الحالة إلى "تأمين" الذكاء الاصطناعي، أي اعتباره مسألة أمن قومي. وبمجرد تبني هذا المنطق، يصبح الذكاء الاصطناعي جزءًا آخر من التنافس بين الدول، حيث تسعى كل دولة لتعظيم قدراتها في الذكاء الاصطناعي، بينما تحاول منع الدول الأخرى من فعل الشيء نفسه.

وقد تصدّرت مجلة "تايم" في عام 2024 غلافًا بعنوان "سباق التسلح في الذكاء الاصطناعي يُغيّر كل شيء"، مشيرة إلى أن هذا السباق بين الشركات قد تكون له تأثيرات مدمّرة تتجاوز تلك التي تسببت بها وسائل التواصل الاجتماعي، بما في ذلك "انهيار" صناعة الأخبار، وارتفاع معدلات التضليل، وتحويل المحتوى الصحفي إلى مادة تستهلكها روبوتات تُعيد إنتاجه بشكل مُشوّه، و"أزمة صحية نفسية متصاعدة لدى المراهقين". والمقارنة بين المخاطر المجتمعية للذكاء الاصطناعي وتلك الخاصة بوسائل التواصل الاجتماعي تجسّد تمامًا حالة تهويل "الكآبة"، إذ يُنظر إلى الذكاء الاصطناعي من خلال مشاكل الحاضر ومخاوفه.

ويُجسد مصطلح "سباق التسلح في الذكاء الاصطناعي" أيضًا فكرة تأمين الذكاء الاصطناعي، حيث تُظهر دول مثل الولايات المتحدة والصين اهتمامًا بتطوير الذكاء الاصطناعي كأحد مجالات التنافس على الهيمنة. وأوضح تقرير صادر عن "MIT Technology Review" أن صانعي السياسات في الولايات المتحدة يقودون أجندة تركز على "الفوز" بسباق الذكاء الاصطناعي ضد الصين. ووفقًا للتقرير، فإن "منافسة الذكاء الاصطناعي تُعرض بشكل متزايد ضمن مصطلحات ضيقة للأمن القومي، وكأنها لعبة صفرية، وتُهيمن عليها افتراضات مفادها أن حربًا مستقبلية بين الولايات المتحدة والصين، تتركز حول تايوان، أمر لا مفر منه"، وأن الذكاء الاصطناعي سيكون له دور حاسم فيها. وبالمثل، ناقش خبراء في جلسة عقدها "مجلس العلاقات الخارجية" عام 2025 تسليح الذكاء الاصطناعي، ودمجه في أنظمة الأسلحة القائمة، وأهمية الحفاظ على تفوق الولايات المتحدة في هذا المجال. حتى السباق بين الشركات الأمريكية في مجال الذكاء الاصطناعي بات يتأثر بسباق التسلح الوطني، حيث تعهدت شركات أمريكية بمساعدة بلدها "للتفوق على الصين".

تهويل "الهلاك" (Doom) هو الأكثر سلبية، ويقترح أن الذكاء الاصطناعي قد يُشكل نهاية البشرية. هذا النوع من التهويل هو ما يتبناه أولئك الذين يدعون إلى وقف مؤقت لتطوير الذكاء الاصطناعي، والذين يحذرون من السماح له بإدارة تقنيات حساسة مثل الأسلحة الذاتية أو الترسانات النووية. وينبع هذا التهويل من خوف وجودي عميق. فحالة "الهلاك" هذه تُشكّل الموقف التنظيمي للعديد من الدول، وتدفع صناع السياسات إلى السعي نحو وضع أطر تنظيمية للذكاء الاصطناعي، أولًا على المستوى الوطني، ثم على الصعيد الدولي. كما أن هذا التهويل يدفع صناع القرار إلى التعامل مع الذكاء الاصطناعي كفاعل صاحب نية وقدرة، وليس كمجرد تقنية كالميكروويف أو المحمصة. وبهذا يُنظر إليه ككائن شبيه بالبشر، يتمتع بنوايا وذكاء واحتياجات وهموم، ويُفترض بالتالي أنه سيسعى للبقاء حتى على حساب الآخرين.

وقد كشفت دراسة أُجريت عام 2022 بين باحثي الذكاء الاصطناعي أن ما يقرب من نصفهم يرون أن هناك احتمالًا واقعيًا بأن يؤدي الذكاء الاصطناعي إلى مخاطر كارثية مثل انقراض الجنس البشري. وفي عام 2025، حذر خبراء الذكاء الاصطناعي من أن "الحد من خطر الانقراض الذي قد تسببه أنظمة الذكاء الاصطناعي يجب أن يُعد أولوية عالمية، على قدم المساواة مع مخاطر الأوبئة أو الحروب النووية". وفي العام نفسه، حذر خبراء من معهد ماساتشوستس للتكنولوجيا من أن أنظمة الذكاء الاصطناعي قد تصل قريبًا إلى مستوى ذكاء بشري وقد "تتصادم" مع البشر أو "تعارض" محاولات السيطرة عليها. واستخدام مصطلحات مثل "تصادم" و"معارضة" يُجسد التصور الذي يرى الذكاء الاصطناعي كفاعل ذكي لديه دوافع وقدرة على استخدام أسلحة يوم القيامة ضد البشرية. وأشار الداعون إلى إيقاف مؤقت لتطوير الذكاء الاصطناعي إلى تصريحات جيفري هينتون، الخبير الرائد في الذكاء الاصطناعي والحائز على جائزة نوبل، الذي قال إن فرصة انقراض جماعي بسبب الذكاء الاصطناعي قد تصل إلى 50%.

كما أن سيناريو "الهلاك" هذا أثّر في تحركات صناع السياسات. ففي فبراير 2025، أعلنت وزارة الخارجية الكورية عن إطلاق قسم دبلوماسية الذكاء الاصطناعي، المسؤول عن التفاوض بشأن تنظيم الذكاء الاصطناعي مع الحلفاء ودول العالم، مع ضمان بقاء كوريا في طليعة التنظيم العالمي لهذا المجال. وفي عام 2024، تم توقيع معاهدة من قبل مجلس أوروبا والولايات المتحدة والمملكة المتحدة ودول أخرى، تتضمن تنظيمًا مشتركًا لضمان "الاستخدام المسؤول للذكاء الاصطناعي، مع التركيز على حماية حقوق الإنسان والديمقراطية وسيادة القانون". ودعت المعاهدة المشاركين إلى تحديد وتقييم وتقديم حلول للأنظمة القائمة على الذكاء الاصطناعي التي قد تهدد الحريات الإنسانية أو البشرية نفسها. أما قانون الذكاء الاصطناعي للاتحاد الأوروبي لعام 2025 فقد تضمّن تصنيفًا جديدًا لمخاطر أنظمة الذكاء الاصطناعي، اعتبر بعضها "غير مقبول"، وقام بحظر تطويرها داخل دول الاتحاد، بما في ذلك الأنظمة التي قد تراقب أو تتجسس على البشر.

لكن في نهاية المطاف، فإن التهويلات ليست سوى رؤى محتملة للمستقبل. إنها تنبؤات مبنية على معلومات محدودة ومشحونة بمشاعر شديدة من الأمل أو الخوف. وتؤدي هذه التهويلات إلى خنق الإبداع، إذ تقل احتمالية أن يتخيل صناع السياسات والدول مجموعة واسعة من الاحتمالات المستقبلية — بعضها أفضل، وبعضها أسوأ. وتترسخ هذه التهويلات في أذهان صناع القرار من خلال تداولها العالمي في الأخبار والأفلام والمسلسلات والخيال الشعبي. لكنها تُخفي حقيقة بسيطة: أن تأثير التكنولوجيا على المجتمع نادرًا ما يمكن التنبؤ به بدقة.

قليلون كانوا يتوقعون أن يؤدي اختراع المطبعة إلى نشأة الدولة القومية، أو أن يؤدي خط الإنتاج الصناعي إلى ثورات شيوعية، أو أن تؤدي وسائل التواصل الاجتماعي إلى تمزق المشهد السياسي. والمشكلة هي أن التهويلات كثيرًا ما تتحول إلى نبوءات تحقق ذاتها. فعلى سبيل المثال، قد تتحقق تهويلات "الكآبة" مع تصاعد أمننة الذكاء الاصطناعي، ما قد يقود إلى حروب ذكاء اصطناعي تسعى فيها الدول إلى غزو أراضٍ لضمان إمدادات المعادن اللازمة لصناعة رقائق الحاسوب. إن تهويلات المستقبل قد تُشكّل بذلك مستقبلنا الفعلي.

وتجاوز "فخ التهويل" ليس بالأمر السهل، لكنه سيكون حاسمًا إذا ما أرادت الدول والمجتمعات استغلال الإمكانات الكاملة للذكاء الاصطناعي والتقليل من مخاطره. والطريقة المثلى لتعزيز التفكير الإبداعي لدى صناع السياسات هي من خلال إشراك مجموعة متنوعة من الأطراف الفاعلة، القادرة على تخيّل طيف واسع من السيناريوهات المستقبلية، والتي لا تتقيد بخطابات التهويل السائدة. وقد تسعى بعض الدول إلى اتباع مثل هذه السياسة من خلال "سفارات التكنولوجيا" التابعة لها في وادي السيليكون. وتُعنى هذه السفارات بإدارة العلاقات مع عمالقة التكنولوجيا ورجال الأعمال التقنيين، ووضع السياسات ذات الصلة، كالتعامل مع التضليل وخطاب الكراهية. لكن يمكن توسيع هذا الدور ليشمل الذكاء الاصطناعي أيضًا. فقد ينخرط صناع السياسات في هذه السفارات مع مجموعة واسعة من الأطراف، من مديري الشركات التقنية، إلى المستثمرين الأوائل، إلى الأفراد العاملين في وحدات البحث والتطوير، ومنظمات المجتمع المدني، والناشطين، والمنظمات غير الحكومية، والأكاديميين، والمستقبليين، والفنانين، وغيرهم. ومن خلال هذه التفاعلات، قد تنشأ رؤى جديدة لمستقبل الذكاء الاصطناعي، وقد تتضح تطبيقات جديدة له، ومن ثم تتمكن الدول من ملاحقة تلك الرؤى المستقبلية التي تنسجم بشكل أفضل مع مصالحها واحتياجاتها وآمالها.

يمكن أن تكون حالات التهويل إيجابية أو سلبية. فظهور الإنترنت أيضًا ترافق مع مخاوف من التفاوت بين الأغنياء والفقراء، أو بين من يستطيع تحمل كلفة الاتصال بالإنترنت ومن سيُستبعد من الساحة الرقمية الجديدة. وهذا ينطبق أيضًا على الذكاء الاصطناعي، إذ يحذّر البعض من أن تطوره قد يبلغ حدًا يجعله يخرج عن السيطرة، ويتجاهل برمجته، ويطلق كوارث غير مسبوقة كالحروب النووية. ما يثير الانتباه في حالات التهويل التكنولوجية هو أنها تشكّل السياسات الحكومية. فحالات التهويل تمثل رؤى مستقبلية، وهي خرائط ذهنية تحدد مجموعة من السيناريوهات الممكنة. ومع ذلك، فإن هذه الرؤى المستقبلية تضع قيودًا على صانعي السياسات، إذ تعيق خيالهم وتمنعهم من توظيف التقنيات الجديدة بطرق مبتكرة وأصيلة. وبدلًا من ذلك، يبدأ صانعو السياسات في رؤية التكنولوجيا من خلال عدسة ضيقة تتشكّل بفعل بعض التصورات السائدة. حاليًا، يبدو أن الدول وصناع السياسات ينظرون إلى الذكاء الاصطناعي من خلال أربع حالات تهويل رئيسية: التفتح (Bloom)، الازدهار المفاجئ (Boom)، الكآبة (Gloom)، والهلاك (Doom).

حالة التهويل "التفتح" ذات طابع إيجابي بطبيعتها، إذ تشير إلى أن الذكاء الاصطناعي سيرفع جودة حياتنا. ستُسهّل تقنيات الذكاء الاصطناعي الطب المُخصص، والرعاية عن بُعد، والطب عن طريق الاتصال، مما يتيح للدول تقديم أفضل رعاية ممكنة للمواطنين. كما سيُنتج المعلمون الآليون مناهج تعليمية مخصصة لكل طالب، مما يساعدهم على تحقيق كامل إمكاناتهم. وستُسهم تقنيات الذكاء الاصطناعي في التنبؤ بالأزمات وحالات الطوارئ والاستجابة لها بسرعة، مع خفض كلفة الخدمات، مثل خفض فواتير الكهرباء بفضل المنازل الذكية. ستصبح الدولة القائمة على الذكاء الاصطناعي أكثر ذكاءً ونظافة وكفاءة. وهذه الرؤية هي ما يؤثر على قرارات صناع السياسات بدمج الذكاء الاصطناعي في مختلف أنظمة الدولة، كالرعاية الصحية والتعليم وحتى الدبلوماسية.

أحد الأمثلة على ذلك هو الاقتراح بإدماج الذكاء الاصطناعي في وزارات الخارجية. ففي يونيو 2023، نشرت اللجنة الاستشارية الأمريكية للدبلوماسية العامة تقريرًا يوضح كيف يمكن للذكاء الاصطناعي أن يتولى وظائف دبلوماسية روتينية، كصياغة بيانات صحفية، وإعداد تقارير، وكتابة محتوى موجه لجماهير مختلفة، واستخدام روبوتات للرد على الطلبات القنصلية. في جميع هذه الحالات، يتمثل الفائدة الأساسية في تقليل عبء العمل على الدبلوماسيين وتمكينهم من العمل بكفاءة وسرعة أكبر. وبالمثل، في مايو 2024، كشفت وزارة الخارجية الأوكرانية عن ناطق رسمي بالذكاء الاصطناعي بهدف صريح يتمثل في "توفير الوقت والموارد"، حيث يتمكن هذا الناطق من الرد على الأحداث أو إعلان التغيرات السياسية بسرعة تفوق أي ناطق بشري. ووفقًا لتقارير المنتدى الاقتصادي العالمي، يجري بالفعل اختبار تقنيات الذكاء الاصطناعي ونشرها في مجالات أخرى، كأنظمة الرعاية الصحية. وتشير التقارير إلى أن الذكاء الاصطناعي يُستخدم لتحسين التشخيصات، وتقصير وقت استجابة سيارات الإسعاف، وتقليل التكاليف الإدارية، والتنبؤ بالمضاعفات الصحية. وهنا أيضًا، تُوظف تقنيات الذكاء الاصطناعي بهدف تحسين الخدمات الحكومية مع خفض التكاليف وزيادة الكفاءة. وهذا هو جوهر حالة التهويل "التفتح".

حالة التهويل "الازدهار" (Boom) هي أيضًا ذات طابع إيجابي بطبيعتها، إذ تشير إلى أن الذكاء الاصطناعي سيقود إلى طفرة مالية تُنتج مصادر جديدة للإيرادات، ووظائف جديدة، وصناعات جديدة، وأيدٍ عاملة ماهرة من نوع مختلف. وتشبه هذه الحالة من التهويل ثورة الذكاء الاصطناعي بالثورات الزراعية أو الصناعية التي غيّرت الاقتصاد العالمي إلى الأبد، فبينما دمّرت بعض أشكال العمل، خلقت العديد من الوظائف الأخرى. وهذه الرؤية هي التي تدفع صانعي السياسات والدول إلى الاستثمار في الصناعات المحلية المعتمدة على الذكاء الاصطناعي، وتشجيع رجال الأعمال المحليين للدخول إلى سوق الذكاء الاصطناعي، وتقديم الحوافز والدعم المالي للأبحاث والتطوير القائمة على الذكاء الاصطناعي، مع اعتبار هذه الصناعات أولوية اقتصادية.

وقد خلصت دراسة نُشرت عام 2024 في مجلة "هارفارد بزنس ريفيو" إلى أن تأثير الذكاء الاصطناعي التوليدي على أسواق العمل بات ملموسًا، مشيرة إلى "تحولات محتملة في ديناميكيات سوق العمل على المدى الطويل، قد تجلب معها تحديات وفرصًا على حد سواء". وتوقّع تقرير آخر صادر عن منظمة العمل الدولية أن الذكاء الاصطناعي سيحل محل 10٪ من القوى العاملة على مستوى العالم. ووفقًا لتقرير "مؤشر الذكاء الاصطناعي لعام 2025" الصادر عن جامعة ستانفورد، شهد العام السابق ارتفاعًا حادًا في الاستثمارات العامة والخاصة في تقنيات الذكاء الاصطناعي. فقد بدأت حكومات عديدة بتخصيص موارد كبيرة لتطوير صناعات الذكاء الاصطناعي المحلية، بما في ذلك كندا (2.4 مليار دولار)، الصين (47.5 مليار دولار لصندوق وطني لأشباه الموصلات)، فرنسا (109 مليار يورو)، الهند (1.25 مليار دولار)، والسعودية (100 مليار دولار). وأشارت منظمة الأمم المتحدة للتنمية الصناعية (اليونيدو) في تقرير لها إلى أن الدول النامية "يجب أن تعطي الأولوية وتسعى لتأسيس منظومات قوية للذكاء الاصطناعي" لتقليص الفجوة بينها وبين الدول الأكثر تطورًا. كل هذه الأمثلة تشير إلى أن صانعي السياسات عالميًا، من منظمات دولية كمنظمة العمل الدولية واليونيدو، إلى صانعي السياسات الوطنيين، ينظرون إلى الذكاء الاصطناعي على أنه أداة ستُغيّر الاقتصادات الوطنية وتحقق نموًا كبيرًا، ما يُجسّد جوهر تهويل "الازدهار".

أما حالة التهويل "الكآبة" (Gloom) فهي سلبية بطبيعتها، وترى الذكاء الاصطناعي من خلال عدسة التحديات الراهنة. فالدول وصناع السياسات يشعرون بالقلق من إمكانية استخدام الذكاء الاصطناعي لنشر المعلومات المضللة ونظريات المؤامرة، وتعزيز الاستقطاب السياسي، وتقويض مرونة المجتمعات، وفي النهاية، تدمير الديمقراطيات. وتفترض هذه الحالة أن المستقبل لن يكون إلا نسخة أكثر تشاؤمًا من الحاضر، حيث تولد الروبوتات كميات غير محدودة من المعلومات المزيفة والمقنعة، مما يضعف قدرة الأفراد على فهم الواقع، ويقود إلى أزمات سياسية واسعة النطاق. وتدفع هذه الحالة إلى "تأمين" الذكاء الاصطناعي، أي اعتباره مسألة أمن قومي. وبمجرد تبني هذا المنطق، يصبح الذكاء الاصطناعي جزءًا آخر من التنافس بين الدول، حيث تسعى كل دولة لتعظيم قدراتها في الذكاء الاصطناعي، بينما تحاول منع الدول الأخرى من فعل الشيء نفسه.

وقد تصدّرت مجلة "تايم" في عام 2024 غلافًا بعنوان "سباق التسلح في الذكاء الاصطناعي يُغيّر كل شيء"، مشيرة إلى أن هذا السباق بين الشركات قد تكون له تأثيرات مدمّرة تتجاوز تلك التي تسببت بها وسائل التواصل الاجتماعي، بما في ذلك "انهيار" صناعة الأخبار، وارتفاع معدلات التضليل، وتحويل المحتوى الصحفي إلى مادة تستهلكها روبوتات تُعيد إنتاجه بشكل مُشوّه، و"أزمة صحية نفسية متصاعدة لدى المراهقين". والمقارنة بين المخاطر المجتمعية للذكاء الاصطناعي وتلك الخاصة بوسائل التواصل الاجتماعي تجسّد تمامًا حالة تهويل "الكآبة"، إذ يُنظر إلى الذكاء الاصطناعي من خلال مشاكل الحاضر ومخاوفه.

ويُجسد مصطلح "سباق التسلح في الذكاء الاصطناعي" أيضًا فكرة تأمين الذكاء الاصطناعي، حيث تُظهر دول مثل الولايات المتحدة والصين اهتمامًا بتطوير الذكاء الاصطناعي كأحد مجالات التنافس على الهيمنة. وأوضح تقرير صادر عن "MIT Technology Review" أن صانعي السياسات في الولايات المتحدة يقودون أجندة تركز على "الفوز" بسباق الذكاء الاصطناعي ضد الصين. ووفقًا للتقرير، فإن "منافسة الذكاء الاصطناعي تُعرض بشكل متزايد ضمن مصطلحات ضيقة للأمن القومي، وكأنها لعبة صفرية، وتُهيمن عليها افتراضات مفادها أن حربًا مستقبلية بين الولايات المتحدة والصين، تتركز حول تايوان، أمر لا مفر منه"، وأن الذكاء الاصطناعي سيكون له دور حاسم فيها. وبالمثل، ناقش خبراء في جلسة عقدها "مجلس العلاقات الخارجية" عام 2025 تسليح الذكاء الاصطناعي، ودمجه في أنظمة الأسلحة القائمة، وأهمية الحفاظ على تفوق الولايات المتحدة في هذا المجال. حتى السباق بين الشركات الأمريكية في مجال الذكاء الاصطناعي بات يتأثر بسباق التسلح الوطني، حيث تعهدت شركات أمريكية بمساعدة بلدها "للتفوق على الصين".

تهويل "الهلاك" (Doom) هو الأكثر سلبية، ويقترح أن الذكاء الاصطناعي قد يُشكل نهاية البشرية. هذا النوع من التهويل هو ما يتبناه أولئك الذين يدعون إلى وقف مؤقت لتطوير الذكاء الاصطناعي، والذين يحذرون من السماح له بإدارة تقنيات حساسة مثل الأسلحة الذاتية أو الترسانات النووية. وينبع هذا التهويل من خوف وجودي عميق. فحالة "الهلاك" هذه تُشكّل الموقف التنظيمي للعديد من الدول، وتدفع صناع السياسات إلى السعي نحو وضع أطر تنظيمية للذكاء الاصطناعي، أولًا على المستوى الوطني، ثم على الصعيد الدولي. كما أن هذا التهويل يدفع صناع القرار إلى التعامل مع الذكاء الاصطناعي كفاعل صاحب نية وقدرة، وليس كمجرد تقنية كالميكروويف أو المحمصة. وبهذا يُنظر إليه ككائن شبيه بالبشر، يتمتع بنوايا وذكاء واحتياجات وهموم، ويُفترض بالتالي أنه سيسعى للبقاء حتى على حساب الآخرين.

وقد كشفت دراسة أُجريت عام 2022 بين باحثي الذكاء الاصطناعي أن ما يقرب من نصفهم يرون أن هناك احتمالًا واقعيًا بأن يؤدي الذكاء الاصطناعي إلى مخاطر كارثية مثل انقراض الجنس البشري. وفي عام 2025، حذر خبراء الذكاء الاصطناعي من أن "الحد من خطر الانقراض الذي قد تسببه أنظمة الذكاء الاصطناعي يجب أن يُعد أولوية عالمية، على قدم المساواة مع مخاطر الأوبئة أو الحروب النووية". وفي العام نفسه، حذر خبراء من معهد ماساتشوستس للتكنولوجيا من أن أنظمة الذكاء الاصطناعي قد تصل قريبًا إلى مستوى ذكاء بشري وقد "تتصادم" مع البشر أو "تعارض" محاولات السيطرة عليها. واستخدام مصطلحات مثل "تصادم" و"معارضة" يُجسد التصور الذي يرى الذكاء الاصطناعي كفاعل ذكي لديه دوافع وقدرة على استخدام أسلحة يوم القيامة ضد البشرية. وأشار الداعون إلى إيقاف مؤقت لتطوير الذكاء الاصطناعي إلى تصريحات جيفري هينتون، الخبير الرائد في الذكاء الاصطناعي والحائز على جائزة نوبل، الذي قال إن فرصة انقراض جماعي بسبب الذكاء الاصطناعي قد تصل إلى 50%.

كما أن سيناريو "الهلاك" هذا أثّر في تحركات صناع السياسات. ففي فبراير 2025، أعلنت وزارة الخارجية الكورية عن إطلاق قسم دبلوماسية الذكاء الاصطناعي، المسؤول عن التفاوض بشأن تنظيم الذكاء الاصطناعي مع الحلفاء ودول العالم، مع ضمان بقاء كوريا في طليعة التنظيم العالمي لهذا المجال. وفي عام 2024، تم توقيع معاهدة من قبل مجلس أوروبا والولايات المتحدة والمملكة المتحدة ودول أخرى، تتضمن تنظيمًا مشتركًا لضمان "الاستخدام المسؤول للذكاء الاصطناعي، مع التركيز على حماية حقوق الإنسان والديمقراطية وسيادة القانون". ودعت المعاهدة المشاركين إلى تحديد وتقييم وتقديم حلول للأنظمة القائمة على الذكاء الاصطناعي التي قد تهدد الحريات الإنسانية أو البشرية نفسها. أما قانون الذكاء الاصطناعي للاتحاد الأوروبي لعام 2025 فقد تضمّن تصنيفًا جديدًا لمخاطر أنظمة الذكاء الاصطناعي، اعتبر بعضها "غير مقبول"، وقام بحظر تطويرها داخل دول الاتحاد، بما في ذلك الأنظمة التي قد تراقب أو تتجسس على البشر.

لكن في نهاية المطاف، فإن التهويلات ليست سوى رؤى محتملة للمستقبل. إنها تنبؤات مبنية على معلومات محدودة ومشحونة بمشاعر شديدة من الأمل أو الخوف. وتؤدي هذه التهويلات إلى خنق الإبداع، إذ تقل احتمالية أن يتخيل صناع السياسات والدول مجموعة واسعة من الاحتمالات المستقبلية — بعضها أفضل، وبعضها أسوأ. وتترسخ هذه التهويلات في أذهان صناع القرار من خلال تداولها العالمي في الأخبار والأفلام والمسلسلات والخيال الشعبي. لكنها تُخفي حقيقة بسيطة: أن تأثير التكنولوجيا على المجتمع نادرًا ما يمكن التنبؤ به بدقة.

قليلون كانوا يتوقعون أن يؤدي اختراع المطبعة إلى نشأة الدولة القومية، أو أن يؤدي خط الإنتاج الصناعي إلى ثورات شيوعية، أو أن تؤدي وسائل التواصل الاجتماعي إلى تمزق المشهد السياسي. والمشكلة هي أن التهويلات كثيرًا ما تتحول إلى نبوءات تحقق ذاتها. فعلى سبيل المثال، قد تتحقق تهويلات "الكآبة" مع تصاعد أمننة الذكاء الاصطناعي، ما قد يقود إلى حروب ذكاء اصطناعي تسعى فيها الدول إلى غزو أراضٍ لضمان إمدادات المعادن اللازمة لصناعة رقائق الحاسوب. إن تهويلات المستقبل قد تُشكّل بذلك مستقبلنا الفعلي.

وتجاوز "فخ التهويل" ليس بالأمر السهل، لكنه سيكون حاسمًا إذا ما أرادت الدول والمجتمعات استغلال الإمكانات الكاملة للذكاء الاصطناعي والتقليل من مخاطره. والطريقة المثلى لتعزيز التفكير الإبداعي لدى صناع السياسات هي من خلال إشراك مجموعة متنوعة من الأطراف الفاعلة، القادرة على تخيّل طيف واسع من السيناريوهات المستقبلية، والتي لا تتقيد بخطابات التهويل السائدة. وقد تسعى بعض الدول إلى اتباع مثل هذه السياسة من خلال "سفارات التكنولوجيا" التابعة لها في وادي السيليكون. وتُعنى هذه السفارات بإدارة العلاقات مع عمالقة التكنولوجيا ورجال الأعمال التقنيين، ووضع السياسات ذات الصلة، كالتعامل مع التضليل وخطاب الكراهية. لكن يمكن توسيع هذا الدور ليشمل الذكاء الاصطناعي أيضًا. فقد ينخرط صناع السياسات في هذه السفارات مع مجموعة واسعة من الأطراف، من مديري الشركات التقنية، إلى المستثمرين الأوائل، إلى الأفراد العاملين في وحدات البحث والتطوير، ومنظمات المجتمع المدني، والناشطين، والمنظمات غير الحكومية، والأكاديميين، والمستقبليين، والفنانين، وغيرهم. ومن خلال هذه التفاعلات، قد تنشأ رؤى جديدة لمستقبل الذكاء الاصطناعي، وقد تتضح تطبيقات جديدة له، ومن ثم تتمكن الدول من ملاحقة تلك الرؤى المستقبلية التي تنسجم بشكل أفضل مع مصالحها واحتياجاتها وآمالها.